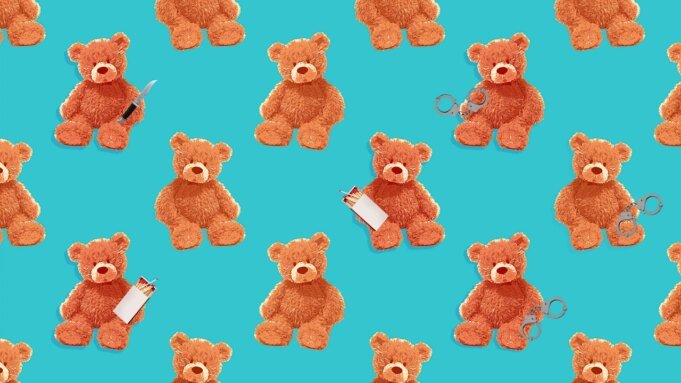

當人工智能驅動的玩具變得失控時

如果您正在考慮給您的孩子買一隻會說話的泰迪熊,您可能會想像它會低聲提供支持性指導並教授世界之道。你可能不會想像它們會參與性角色扮演,或者為幼兒提供有關如何點燃火柴的建議。然而,消費者監督機構公共利益研究小組 (PIRG) 在最近對節日期間的新玩具進行的測試中發現了這一點。 PIRG 發現,FoloToy 的 AI 泰迪熊 Kumma 使用 OpenAI 的 GPT-4o 模型來驅動其語音,在與孩子們交談時非常願意誤入歧途。在兒童玩具中使用 AI 模型的語音模式是有道理的:這項技術是為孩子們喜愛的神奇小玩意量身定制的,可以輕鬆地滑到貨架上,旁邊還有會拉屎和打嗝的栩栩如生的玩偶,以及像電子蛋一樣的數字生物。孩子們想要嘗試並保持活力。問題在於,與前幾代玩具不同,人工智能小玩意可能會超出經過仔細預編程和審查的對兒童友好的反應。 Kumma 的問題凸顯了人工智能玩具的一個關鍵問題:它們經常依賴於他們無法控制的第三方人工智能模型,並且不可避免地可能會被意外或故意地越獄,從而導致兒童安全問題。雷丁大學消費者法專家 Christine Riefa 表示:“關於玩具使用的人工智能模型、它們是如何訓練的以及它們可能包含哪些保護措施來避免兒童遇到不適合其年齡的內容,目前還不清楚。” 因此,兒童權利組織 Fairplay 在假期前向家長發出警告,建議他們為了孩子的安全,遠離人工智能玩具。 “缺乏支持人工智能玩具好處的研究,也缺乏顯示人工智能玩具對兒童長期影響的研究,”Fairplay 幼兒茁壯成長項目總監雷切爾·弗朗茨 (Rachel Franz) 表示。雖然 FoloToy 已經停止銷售 Kumma,OpenAI 也取消了 FoloToy 對其人工智能模型的訪問權限,但這只是眾多人工智能玩具製造商中的一家。如果出現問題,誰該承擔責任?里法表示,這方面也缺乏明確性。 “責任問題可能與數據及其收集或保存的方式有關,”她說。 “這可能涉及人工智能玩具推動孩子傷害自己或他人,或記錄父母銀行詳細信息的責任。”

已发布: 2025-12-22 21:59:00